Представьте себе сценарий: среда производства работает, вы отправляете обновление, и вдруг приложение падает из-за несовместимости схемы таблицы. Это кошмар любого разработчика или инженера DevOps. Миграция схемы БД - это набор изменений структуры базы данных, применяемых последовательно к среде. Если этот процесс настроен неверно, одна ошибка может привести к потере данных или часам простоя. В этом материале мы разберем, как управлять этим процессом безопасно, какие стратегии отката использовать и в какой порядке применять изменения.

Фундаментальные принципы надежности

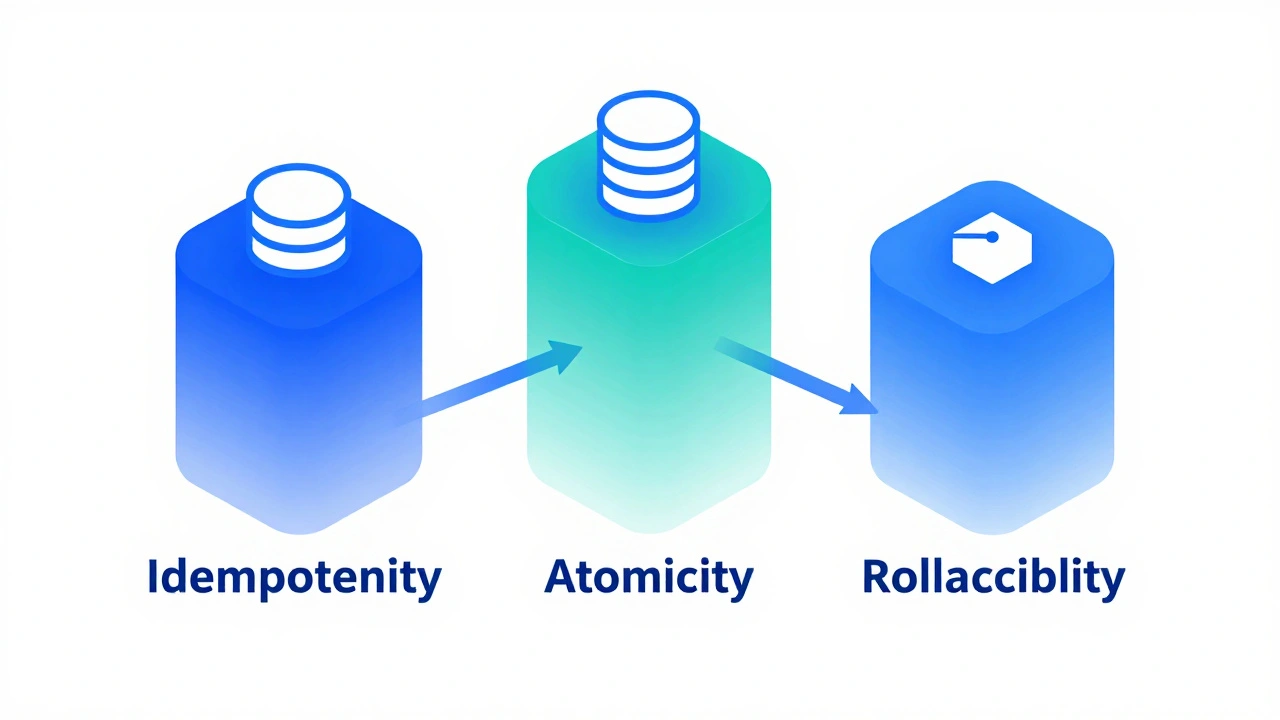

Прежде чем писать скрипты, нужно понять три кита, на которых держится здоровье ваших данных. Первый принцип - идемпотентность. Когда вы запускаете один и тот же скрипт миграции несколько раз, результат должен быть одинаковым, а данные не должны повредиться. Например, команда CASE WHEN NOT EXISTS ... THEN CREATE TABLE позволяет избежать ошибки при повторном запуске.

Второй принцип - атомарность. Изменение должно завершиться полностью либо не примениться вовсе. В PostgreSQL можно упаковать миграцию в одну транзакцию. Если на середине процесса упадет питание, база данных сама откатит все до начала транзакции. Это критично для сохранности информации.

Третий принцип - возможность отката. Каждое изменение должно иметь обратную дорогу. Не всегда можно просто удалить таблицу назад. Иногда проще создать новую версию структуры и перенести данные, чем пытаться восстановить удаленные столбцы.

Типы миграций и их риски

Не все изменения равны по опасности. Добавление новых объектов обычно безопасно. Создать новую колонку, таблицу или индекс почти никогда не приводит к потере старых данных. Это называется обратно совместимым изменением. Вы можете добавить поле user_birthdate и сразу переключить часть трафика на чтение нового поля, не трогая старую логику.

Изменение существующих объектов сложнее. Если нужно изменить тип данных с VARCHAR(50) на VARCHAR(255), риск минимален. Но если вы меняете тип с числового на строковый, придется конвертировать значения. Здесь нужны миграции данных (ETL внутри скрипта). Редизайн схемы, нормализация или перенос данных требуют самого тщательного тестирования. Ошибка здесь может заблокировать работу приложений до восстановления бэкапа.

| Тип изменения | Риск потери данных | Совместимость | Пример |

|---|---|---|---|

| Добавление объектов | Минимальный | Высокая | ALTER TABLE ADD COLUMN |

| Изменение свойств | Средний | Частичная | ALTER COLUMN TYPE |

| Редизайн схемы | Высокий | Нужна миграция | Разделение одной таблицы на две |

Стратегии отката изменений

Откат (rollback) - это способность вернуть систему в работоспособное состояние после сбоя. Самый простой метод - прямой Direct Rollback. Вы пишете скрипт DOWN, который делает ровно наоборот то, что сделал UP. Однако это работает только пока структура проста. Удалить столбец легко, но восстановить его содержимое после удаления невозможно без логов.

Более надежный способ - паттерн "Expand and Contract" (Расширение и Сокращение). Вы создаете новую колонку, заполняете её данными параллельно со старой, затем переключаете приложение на новое поле. Только после этого удаляете старое поле в следующей миграции. Это позволяет сохранить обратную совместимость во время перехода.

Есть еще вариант через фичи и canary-релизы. Если вы используете систему управления функциями (Feature Flags), вы можете включить новое поведение для части пользователей. Если найдутся ошибки, вы просто выключаете флаг, не затрагивая структуру базы. Это самый безопасный метод для продакшена, но он требует поддержки со стороны кода приложения.

Порядок выполнения миграций

Когда меняется модель данных, последовательность действий решает всё. Если у вас есть сервис DataSpace и клиентское приложение, следуйте этому алгоритму. Сначала устанавливается новая версия модели данных. Потом выполняется сам код миграции. И только после этого включается функциональность приложения, которое использует новые изменения.

Почему именно так? Потому что приложение должно видеть старую схему во время прогона миграции. Если начать обновлять приложение первым делом, оно попытается обратиться к полю, которого ещё нет, и упадет.

Альтернативный путь через SQL-скрипты более рискованный. Вы создаете скрипт, переносящий данные из старых структур в новые. Если таблица огромная, делайте перенос группами записей (batching), чтобы не перегрузить сервер. Скрипт нужно выполнить и на основной базе, и на репликах (StandIn).

Особый случай: если в скрипте есть генерируемые значения (например, UUID) или временные метки (timestamps), скрипт применяйте только на основной базе. Затем обязательно выполните полную инициализацию базы StandIn заново. После этого разворачивается новая версия приложения. Важно помнить, что SQL-скрипты часто оставляют «след» вне истории версий сущностей, поэтому ответственность ложится на разработчика.

Инструменты управления: Liquibase vs State-based

Для автоматизации используют два подхода. Первый - Change-based (основанный на изменениях). Каждая миграция имеет номер версии и четкое описание действий. Это стандарт де-факто для Data Warehousing as Code. Инструмент читает список изменений и применяет их по очереди.

Второй подход - State-based (основанный на состоянии). Вы описываете желаемое состояние схемы в YAML-файле. Инструмент сравнивает текущее состояние базы с желаемым и сам считает нужные SQL-команды. Это удобно для общего использования, но часто хуже подходит для сложных DWH-процессов, где важен исторический контекст.

Популярный инструмент Liquibase часто используется в Spring Boot проектах. На практике откат миграций там поддерживается плохо. Стандартный механизм отката часто игнорируется. Если нужно проверить работу, используйте команду updateTestingRollback. Она выполняет цикл: накатил → откатил → снова накатил. Но помните, что она не проверяет целостность бизнес-данных, а лишь техническую применимость команд.

В современных системах GitOps, например с ArgoCD, откат упрощается. Оператор типа Atlas анализирует различия и генерирует миграции для возврата. Однако крайние случаи, связанные с потерей данных, всегда требуют ручного рассмотрения. Автоматизация хороша, но человеческий контроль нужен в финальной точке.

Защита данных и подготовка среды

Перед любым крупным движением сделайте полный бэкап базы данных. Это не обсуждается. Даже если вы уверены в своих скриптах, железо может подвести. Тестируйте миграции на стендах, которые копируют реальный объем данных. Нельзя проверять перенос таблицы в миллион строк на локальном компьютере с десятью записями. Скорость работы и нагрузка на диск могут кардинально отличаться.

Архитектура runner'а миграций должна включать шаг Dry-run. Это значит, что система сначала просчитывает план действий без выполнения команд. Сохраните результаты этой проверки в лог. Если Dry-run прошел успешно, только тогда применяйте изменения к целевой среде с поддержкой операций rollback.

Контроль доступа тоже важен. Лица, запускающие миграции, должны иметь права администратора, но доступ к журналам изменений должен быть ограничен аудиторами. Ведите детальное логирование каждого шага. Если что-то пойдет не так, журнал покажет, где именно завис процесс.

Рекомендации для разных платформ

Работа с разными СУБД имеет нюансы. В PostgreSQL операции DDL поддерживают транзакции. Вы можете начать транзакцию, изменить много таблиц и откатить всё одним действием. В Snowflake или некоторых облачных решениях многие операции DDL работают вне транзакций. Там нельзя просто нажать «кнопку назад».

Для таких систем применяются стратегии копирования и флагов контекста (contexts). Вы создаете временную структуру, копируете данные и переключаете указатели. Это дороже по ресурсам, но безопаснее. При планировании выделяйте достаточно оперативной памяти для целевой базы. Предзагрузка данных в кэш ускорит массовую запись.

Нужен ли откат для каждой миграции?

Да, каждая миграция должна иметь потенциальную возможность отката. Однако на практике часто используют стратегию «безопасного удаления», когда старый объект живет параллельно с новым, и убирается в отдельном шаге через неделю после успешного релиза.

Можно ли использовать Liquibase для переноса данных?

Не рекомендуется. Liquibase заточен под управление схемой (DDL). Для больших объемов ETL лучше использовать специализированные инструменты, такие как Talend или Airflow, чтобы не нагружать систему миграций.

Как предотвратить блокировку таблиц во время рабочего времени?

Используйте Online DDL команды (если СУБД поддерживает, например, Pt-online-schema-change в MySQL). Применяйте миграции поздно ночью или выходными. Для критичных таблиц создавайте индексы через создание дубликатов и переключение имен.

Что делать, если миграция зависла в середине?

Если операция в транзакции - ждите окончания тайм-аута и проверки лога. Если вне транзакции, возможно, понадобится ручное восстановление из бэкапа точки времени (PITR). Всегда имейте актуальную точку восстановления.

Нужно ли тестировать откат перед релизом?

Обязательно. Запустите сценарий «произошла ошибка» на тестовой копии продакшена. Проверьте, что база вернулась в исходное состояние и данные не исказились. Команда updateTestingRollback в Liquibase помогает с этим, но не заменяет полноценный ручной тест.