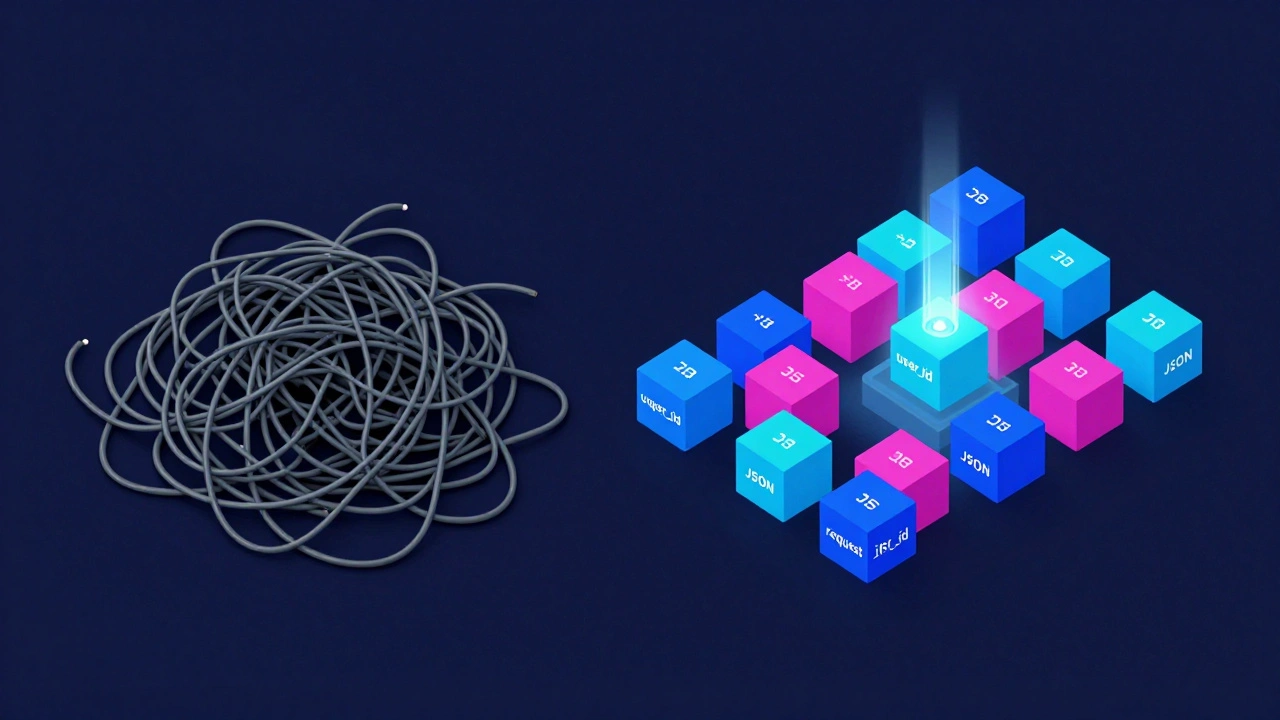

Представьте: ваш сервис падает в три часа ночи, а в логах вы видите бесконечную простыню из текста Error: something went wrong без указания того, какой именно пользователь вызвал эту ошибку и какой запрос привел к сбою. В реальном веб-приложении, где тысячи запросов обрабатываются параллельно, обычные текстовые логи становятся бесполезными. Вам нужно не просто «записывать события», а создавать систему, которая позволит за секунды восстановить цепочку действий пользователя. Именно здесь на помощь приходят структурированное логирование и распределенная трассировка.

Главное о логировании в вебе

- Забудьте про простые

print()или текстовые файлы - используйте JSON-формат для логов. - Каждый запрос должен иметь уникальный

request_id, который проходит через все функции и микросервисы. - Разделяйте уровни важности (INFO, WARNING, ERROR), чтобы не тонуть в информационном шуме на продакшене.

- Используйте внешние системы сбора (Sentry, ELK), так как поиск по текстовым файлам через

grepв 2026 году - это путь к выгоранию.

Почему стандартный logging.info() больше не работает

Когда вы пишете logging - встроенная библиотека Python для регистрации событий, вы обычно создаете строку. Например: logging.info(f"User {user_id} bought item {item_id}"). Для человека это читаемо. Но для машины это кошмар. Чтобы найти все покупки конкретного пользователя, системе придется использовать регулярные выражения, что медленно и ненадежно.

Структурированный лог превращает сообщение в объект. Вместо строки вы записываете JSON: {"event": "item_purchase", "user_id": 42, "item_id": 101, "level": "INFO"}. Теперь любой инструмент анализа (например, Kibana) может мгновенно отфильтровать все события по полю user_id.

Как внедрить структурирование с помощью structlog

Если стандартная библиотека слишком громоздкая, многие переходят на structlog - библиотека для Python, позволяющая создавать логи в виде словарей до их окончательного форматирования. Она позволяет добавлять контекст к логам на лету.

Допустим, в начале обработки HTTP-запроса вы добавляете в контекст request_id и ip_address. Теперь каждый последующий вызов log.info("Processing payment") в любом месте кода автоматически прикрепит эти данные к записи. Вам не нужно передавать идентификатор запроса через все функции как аргумент.

| Критерий | Текстовый лог (Plain Text) | Структурированный лог (JSON) |

|---|---|---|

| Поиск | Медленный (grep / regex) | Мгновенный (по ключам/полям) |

| Аналитика | Почти невозможна без парсинга | Легко строить графики и отчеты |

| Читаемость человеком | Высокая | Средняя (требует просмотрщика JSON) |

| Нагрузка на CPU | Минимальная | Чуть выше из-за сериализации в JSON |

Трассировка запросов: сквозной идентификатор

В современной архитектуре один запрос от клиента может затронуть API-шлюз, сервис пользователей, сервис заказов и базу данных. Если ошибка случилась в самом конце цепочки, как понять, какой именно запрос ее вызвал? Для этого используется Distributed Tracing - метод отслеживания пути запроса через всю систему с помощью уникального Trace ID.

Схема работы простая:

- При поступлении запроса в систему генерируется уникальный

trace_id(например, UUID4). - Этот ID добавляется в HTTP-заголовок (обычно

X-Trace-IDили стандартW3C Trace Context). - Все сервисы, которые получают этот запрос, записывают этот ID в каждый свой лог.

- При поиске ошибки вы берете один ID и видите полную историю перемещения запроса между всеми сервисами.

Для реализации этого в Python часто используют OpenTelemetry - открытый стандарт и набор инструментов для создания телеметрии: трасс, метрик и логов. Он позволяет автоматически собирать данные о времени выполнения функций и передавать их в системы визуализации.

Стек инструментов для сбора и анализа

Логи в файлах на сервере бесполезны, если у вас больше двух экземпляров приложения. Вам нужен централизованный сборщик. Самый популярный вариант - ELK Stack - набор из Elasticsearch (хранение), Logstash/Fluentd (сбор) и Kibana (визуализация). Логи в формате JSON отправляются в Elasticsearch, где они индексируются по каждому полю.

Однако для отслеживания критических ошибок лучше подходит Sentry - платформа для мониторинга ошибок в реальном времени, которая группирует похожие сбои и прикрепляет к ним стек вызовов. В отличие от ELK, Sentry не просто хранит текст, а анализирует состояние переменных в момент падения приложения.

Ловушки и лучшие практики

Многие разработчики совершают ошибку, ставя уровень DEBUG на продакшене. Это приводит к двум проблемам: во-первых, диски забиваются гигабайтами бесполезного текста, во-вторых, приложение начинает тормозить из-за постоянной записи в I/O. Всегда используйте INFO или WARNING для рабочих сред.

Еще один важный момент - ротация логов. Если вы все еще пишете в файлы, используйте RotatingFileHandler или TimedRotatingFileHandler. Это механизмы, которые автоматически создают новый файл, когда старый достигает, например, 100 МБ, и удаляют самые древние записи. Без этого ваш сервер просто выключится из-за переполнения диска.

Не забывайте о безопасности. Никогда не записывайте в логи пароли, токены доступа или номера кредитных карт. Ошибка в одной строке кода может привести к тому, что все секреты пользователей окажутся в открытом виде в системе сбора логов, к которой имеет доступ вся команда разработки.

Что лучше: стандартный logging или structlog?

Стандартный logging подходит для маленьких скриптов и простых приложений. Structlog незаменим в веб-разработке и микросервисах, так как он позволяет работать с логами как с данными (словарями), что критично для JSON-вывода и интеграции с ELK.

Как передать request_id между сервисами?

Самый надежный способ - через HTTP-заголовки. Первый сервис генерирует ID и отправляет его в заголовке (например, X-Request-ID). Следующий сервис считывает этот заголовок и использует его в своих логах. Если заголовка нет, сервис создает новый.

Не замедлит ли JSON-логирование работу приложения?

Сериализация в JSON требует чуть больше ресурсов процессора, чем конкатенация строк. Однако в веб-приложениях узким местом обычно является сеть или база данных, а не запись логов. Чтобы минимизировать влияние, используйте асинхронные обработчики логов.

В чем разница между логами и трассировкой (tracing)?

Логи - это дискретные события («пользователь нажал кнопку»). Трассировка - это запись всего пути запроса от входа до выхода, включая время ожидания между сервисами. Трассировка отвечает на вопрос «почему запрос шел 5 секунд?», а логи - на вопрос «что именно произошло?».

Как избежать забивания диска логами?

Используйте ротацию логов (RotatingFileHandler) или, что еще лучше, настройте вывод логов в стандартный поток вывода (stdout). В современной Docker-инфраструктуре принято, чтобы приложение просто «выплевывало» логи в консоль, а внешняя система (например, Fluentd или Promtail) забирала их и отправляла в хранилище.

Следующие шаги по настройке

Если вы только начинаете, попробуйте заменить стандартный вывод логов на JSON с помощью библиотеки python-json-logger. Это самый простой способ начать структурирование без переписывания всего кода. Затем интегрируйте бесплатный уровень Sentry для отслеживания исключений - это сэкономит вам часы ручного поиска багов.

Для тех, кто строит сложную систему из нескольких сервисов, следующим шагом станет внедрение OpenTelemetry. Начните с автоматического сбора трейсов для HTTP-запросов, а затем постепенно добавляйте метки к важным бизнес-операциям. Так вы превратите свои логи из «текстового кладбища» в мощный инструмент диагностики.