Пользователь нажимает кнопку «Загрузить профиль», и экран зависает. Три секунды ожидания кажутся вечностью. В это время ваш сервер спотыкается о базу данных, пытаясь собрать информацию из десятков таблиц. Если бы эти данные уже лежали ближе - например, в оперативной памяти - ответ пришел бы за миллисекунды. Именно для этого существует кэширование данных, которое является техникой хранения часто запрашиваемой информации в быстром доступе (обычно в RAM) для снижения нагрузки на основное хранилище и ускорения отклика системы.

Без продуманной стратегии кэша ваше приложение быстро упрется в лимиты соединений с базой данных. С правильной стратегией вы сможете обслуживать тысячи пользователей одновременно, не покупая новые серверы. Давайте разберемся, как настроить эту систему так, чтобы она работала на вас, а не создавала проблемы с актуальностью информации.

Почему нельзя просто хранить всё в кэше?

Идеальный мир предполагает бесконечную память. Реальность такова, что оперативная память ограничена и дорога. Вы не можете держать там всю базу данных. Поэтому ключевой метрикой эффективности становится hit ratio - процент попаданий запросов в кэш. Для горячих данных (тех, которые читают чаще всего) целевое значение должно превышать 90%.

Когда место в кэше заканчивается, вступает в силу механизм вытеснения (eviction). Система должна решить, какие данные удалить, чтобы освободить место для новых. От того, какой алгоритм вы выберете, зависит, насколько быстро пользователи будут получать нужную им информацию.

Стратегии чтения: кто управляет данными?

Существует несколько подходов к тому, как приложение взаимодействует с кэшем и базой данных при чтении. Выбор зависит от того, насколько сильно вы хотите связать бизнес-логику с инфраструктурой.

| Стратегия | Как работает | Плюсы | Минусы |

|---|---|---|---|

| Cache Through (Read Through) | Приложение обращается только к кэшу. Если данных нет, сам кэш идет в БД, загружает их и возвращает приложению. | Бизнес-логика чистая, скрыта сложность работы с БД. | Требует поддержки со стороны кэш-системы (например, Redis). |

| Cache Aside (Read Aside) | Приложение сначала проверяет кэш. Если промах - само идет в БД, затем обновляет кэш. | Гибкость, полный контроль над тем, что кэшируется. | Усложнение кода приложения, риск гонки процессов (race condition). |

| Cache Ahead | Данные загружаются в кэш заранее или по расписанию. Запросы идут только в кэш. | Максимальная скорость чтения, защита БД от пиковых нагрузок. | Риск выдачи устаревших данных, невозможность прочитать свежее сразу. |

Стратегия Cache Aside (или ленивое кэширование) является наиболее популярной в веб-разработке. Она проста: если данных нет в кэше, мы идем в базу, берем их, кладем в кэш и отдаем пользователю. Это минимизирует нагрузку на базу при повторных запросах. Однако здесь есть подводный камень: если два пользователя одновременно запросят отсутствующий объект, они оба могут пойти в базу данных параллельно. Чтобы избежать этого, используют блокировки или флаги загрузки.

Стратегия Cache Through перекладывает ответственность на саму систему кэширования. Приложение видит кэш как единственное окно доступа к данным. Это делает код чище, но требует, чтобы ваша кэш-система умела работать с источниками данных напрямую.

Стратегии записи: согласованность против скорости

Чтение - это половина дела. Гораздо сложнее организовать запись, чтобы данные в кэше не расходились с данными в базе. Здесь используются две основные модели.

- Write Through: При изменении данных приложение пишет их в кэш, а кэш (или приложение) синхронно обновляет базу данных. Это гарантирует консистентность: пользователь всегда видит актуальную информацию. Но цена - повышенная задержка при записи, так как нужно ждать ответа от медленной базы.

- Write Back (Write Behind): Данные пишутся только в кэш, а в базу отправляются позже, пакетно или асинхронно. Это дает огромную скорость записи и снижает нагрузку на диск базы данных. Риск заключается в потере данных при сбое кэш-сервера до того, как запись попадет в базу.

Для большинства приложений, где важна целостность транзакций (например, банковские операции), выбирают Write Through. Для систем с высокой нагрузкой на запись, таких как счетчики просмотров или логи событий, отлично подходит Write Back.

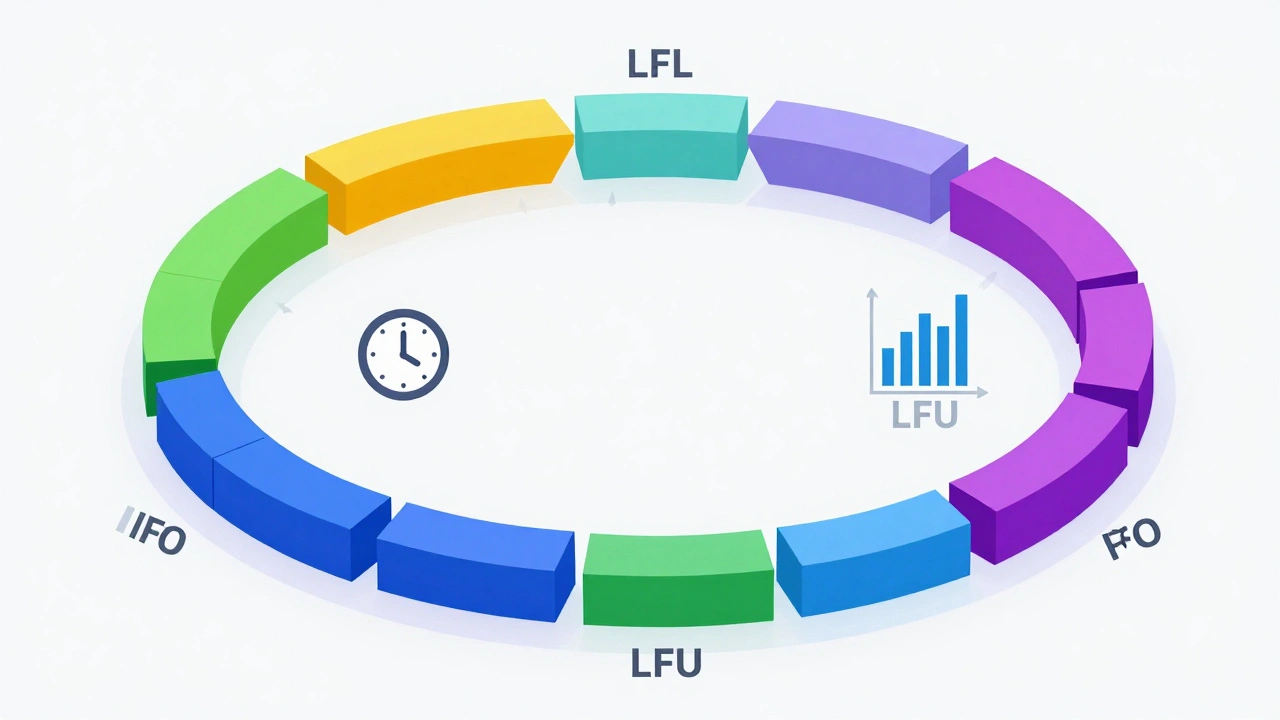

Алгоритмы вытеснения: что удалять первым?

Когда память заполняется, системе нужно решение. Выбор алгоритма зависит от паттернов доступа ваших пользователей.

- LRU (Least Recently Used): Удаляет элементы, к которым дольше всего не обращались. Исходит из предположения, что недавно просмотренные данные скоро понадобятся снова. Это стандарт де-факто для большинства веб-приложений. Например, NCache позволяет настраивать интенсивность удаления именно на основе LRU.

- LFU (Least Frequently Used): Удаляет те элементы, которые реже всего использовались за все время. Полезно, если у вас есть «вечные» популярные страницы, которые должны всегда оставаться в кэше, даже если к ним не обращались пару минут.

- FIFO (First In First Out): Простая очередь. Первый вошел - первый вышел. Подходит для простых логов или очередей задач, где порядок важен больше, чем частота использования.

- TTL (Time To Live): У каждой записи есть срок годности. По истечении времени она автоматически удаляется. Идеально для кэширования курсов валют, погоды или новостей, которые быстро устаревают.

В распределенных системах важно, чтобы политика LRU применялась равномерно по всем узлам кластера. Иначе один сервер может забиться мусором, пока другой будет пустовать, что приведет к неравномерной нагрузке.

Уровни кэширования: от браузера до CDN

Кэш не обязательно должен жить только внутри вашего бэкенда. Эффективная архитектура использует многоуровневое кэширование.

- CDN (Content Delivery Network): Кэширует статический контент (картинки, CSS, JS) географически близко к пользователю. Снижает latency для глобальной аудитории.

- Reverse Proxy: Серверы вроде Nginx могут кэшировать ответы API. Это защищает ваш бэкенд от повторных одинаковых запросов.

- In-Memory Cache (Redis, Memcached): Хранение структурированных данных в оперативной памяти серверов приложения. Самый быстрый слой после клиентского кэша.

- Database Query Cache: Встроенное кэширование результатов запросов внутри самой СУБД (например, MySQL Query Cache, хотя в новых версиях его часто отключают из-за проблем с блокировками).

Комбинируя эти уровни, вы создаете «слои защиты». CDN берет на себя статику, прокси - повторяющиеся GET-запросы, а Redis - сложные агрегированные данные профиля пользователя.

Инструменты реализации

Выбор технологии зависит от масштаба и стека. Redis сегодня является лидером благодаря поддержке сложных структур данных (списки, хэши, множества) и возможности публикации/подписки. Он поддерживает как локальное, так и распределенное кэширование.

Memcached - более простой вариант, который хорошо зарекомендовал себя для больших сервисов с простыми задачами кэширования строк. Он не поддерживает репликацию из коробки, поэтому требует дополнительной настройки для отказоустойчивости.

Если вы работаете в экосистеме Microsoft, стоит рассмотреть Azure Cache for Redis или Windows Server App Fabric. Они интегрируются с облачными сервисами и предоставляют управляемые решения, избавляя от необходимости администрировать кластеры вручную.

Типичные ошибки и как их избежать

Даже правильная стратегия может дать сбой, если её неправильно применить. Вот три главные ловушки:

- Кэширование слишком больших объектов: Не храните целые JSON-ответы, если пользователю нужны только три поля. Минимизируйте размер ключей и значений. Используйте сжатие (gzip/snappy) для крупных блоков данных.

- Отсутствие инвалидации: Если вы забыли удалить запись из кэша при обновлении данных в базе, пользователи увидят старую версию («грязное чтение»). Всегда привязывайте TTL к критичности данных. Для профилей пользователей TTL может быть 5 минут, для настроек системы - 1 час.

- Thundering Herd (Эффект стада): Когда у популярного ключа истекает TTL, тысячи пользователей одновременно пытаются обновить его, обрушиваясь на базу данных. Решение: использовать случайную дельту времени для TTL или блокировку обновления (lock), чтобы обновлял кэш только один поток.

Помните, что кэширование - это компромисс между скоростью и актуальностью. Нет универсального рецепта. Анализируйте логи доступа, измеряйте hit ratio и адаптируйте стратегии под конкретные эндпоинты вашего API.

Что лучше использовать: Redis или Memcached?

Redis предпочтительнее для современных приложений, так как он поддерживает сложные структуры данных, транзакции, репликацию и различные типы вытеснения (LRU, LFU). Memcached проще и быстрее для базового кэширования строк, но не имеет встроенных механизмов отказоустойчивости и продвинутых функций. Если вам нужно просто кэшировать результаты SQL-запросов - Memcached подойдет. Если нужна очередь задач, сессии или сложная логика - выбирайте Redis.

Как определить оптимальное время жизни (TTL) для кэша?

TTL зависит от частоты изменения данных. Для статического контента (текст статей, изображения) TTL может составлять дни или недели. Для динамических данных (курсы валют, погода) - минуты. Для пользовательских профилей, которые редко меняются, но требуют относительной свежести, обычно устанавливают TTL от 5 до 30 минут. Используйте правило: чем дороже обновление данных для базы, тем дольше можно держать их в кэше.

Что такое «грязное чтение» в контексте кэширования?

Грязное чтение происходит, когда пользователь получает устаревшие данные из кэша, потому что они были обновлены в базе данных, но кэш не был инвалидирован. Это приводит к несогласованности состояния системы. Чтобы избежать этого, используйте стратегии Write Through или явно удаляйте соответствующие ключи из кэша при каждом обновлении данных в базе.

Стоит ли кэшировать ответы API на уровне клиента (браузера)?

Да, но с осторожностью. Браузерное кэширование через HTTP-заголовки (Cache-Control, ETag) значительно снижает нагрузку на сеть и ускоряет повторные загрузки страниц. Однако для данных, требующих строгой конфиденциальности или мгновенного обновления (например, баланс счета), следует отключать кэширование или использовать короткие TTL и механизмы ручной инвалидации через Service Workers.

Как бороться с эффектом Thundering Herd?

Эффект возникает, когда множество клиентов одновременно запрашивают просроченный кэш. Решения включают: 1) Добавление случайной задержки к TTL (jitter), чтобы ключи истекали в разное время. 2) Использование блокировок (mutex), чтобы только один процесс обновлял кэш, пока остальные ждут или получают старые данные. 3) Предварительное обновление кэша до истечения TTL (background refresh).