Почему ваш код падает на больших объемах данных

Представьте ситуацию: вы пишете скрипт, который скачивает архив весом в 5 гигабайт. Он запускается, и через секунду браузер зависает или сервер отдает ошибку OutOfMemoryError. Это происходит не потому, что у вас мало ресурсов, а потому что ваше приложение пытается загрузить всё содержимое в оперативную память сразу целиком. В мире, где данные растут экспоненциально, способность обрабатывать информацию маленькими кусочками становится критической.

Традиционный подход с блокирующими запросами (fetch, read) просто не работает для огромных файлов или высоких нагрузок. Здесь на сцену выходят Асинхронные стримы и концепция управления потоком передачи данных. Они позволяют передавать информацию чанками (кусками), давая вам контроль над тем, как быстро эти кусочки поступают к вам. Без этого механизма любая система рано или поздно столкнется с проблемой переполнения буфера.

Суть проблемы: кто диктует скорость передачи?

Основная сложность в работе с большими данными заключается в несоответствии скоростей. Представьте садовый шланг: если один конец подключен к мощному насосу, а второй закрыт краником, давление начнет расти, пока труба не лопнет. Так же работают компьютерные системы. Сервер может отправлять мегабайты данных в секунду, а клиент или база данных на另一端 может успевать обрабатывать лишь несколько килобайт.

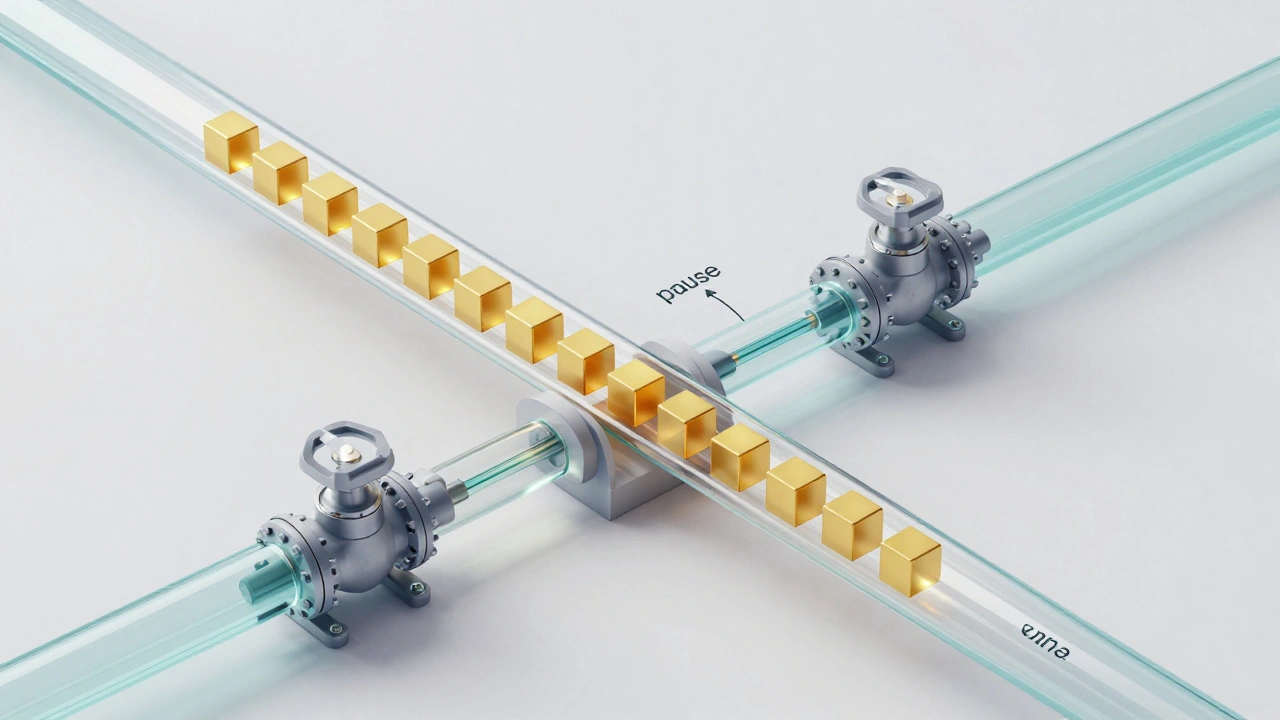

Backpressure - это механизм обратного давления, который решает эту проблему. Проще говоря, это способ сказать источнику данных: «Стоп, я еще не готов принять следующую порцию». Вместо того чтобы накапливать данные в бесконечном буфере, потребитель запрашивает именно столько элементов, сколько способен обработать. Если бы мы использовали обычную очередь задач, она бы выросла до размера доступной RAM, после чего система бы упала.

В реальности это работает так: когда потребитель вызывает метод `read()`, он указывает размер интересующего его батча. Издатель (источник) приостанавливает генерацию данных, пока потребитель не сделает новый запрос. Это превращает поток из непрерывного потока воды в управляемую доставку посылок.

Работа с файлами и асинхронным чтением

Чтение локальных файлов часто воспринимается как простая задача, но при размере файла в десятки гигабайт традиционные методы становятся опасными. Вы не можете прочитать файл целиком в строку, даже если используете современный язык программирования.

- Метод чтения: Используйте последовательное чтение чанков фиксированного размера (например, по 8 КБ).

- Обработка: Каждый чанк должен обрабатываться отдельно, например, парситься как JSON или добавляться в индекс поисковой системы.

- Контроль: Между операциями чтения и обработки должна быть синхронизация. Не начинайте читать следующий байт, пока предыдущий не будет сохранен или проанализирован.

В современных языках, таких как Java 9+, используется интерфейс `java.util.concurrent.Flow`. Потребитель (Subscriber) сообщает производителю (Publisher) через метод `request(long n)`, сколько данных он готов принять. Производитель обязан уважать этот запрос. Если производитель пытается прислать больше, чем запрошено, поведение считается ошибкой спецификации. В браузерах стандарт Web Streams предоставляет аналогичный функционал через объект ReadableStream.

Веб-потоки и сетевая асинхронность

При работе с сетью ситуация усложняется нестабильностью соединения. Web Streams API стал стандартом де-факто для потоковой передачи данных в браузере. Этот стандарт позволяет работать с ответами от fetch-запросов не только как с конечным результатом, но и как с потоком событий.

Особенно актуально это для технологий вроде Server-Sent Events (SSE) или HTTP-стриминга. Классический HTTP-запрос живет секунды, а потоковое соединение может длиться часами. Каждое событие в таком потоке требует сериализации, отправки и десериализации. Если пользователь находится в плохой зоне покрытия сети, а сервер продолжает гнать терабайты событий, браузер начинает тормозить.

| Подход | Управление памятью | Реакция на сбои | Пример реализации |

|---|---|---|---|

| Blochering (без стримов) | Высокая нагрузка | Падение приложения | readAllBytes() |

| Асинхронные стримы | Постоянный уровень | Пауза/Отмена | pipeTo/WritableStream |

| Рективные фреймворки | Динамическая регулировка | Перезапуск потока | React Flow, Flux |

Инструменты для реализации backpressure

Разные языки и платформы предлагают свои решения. В экосистеме Java золотым стандартом стало семейство библиотек ReactiveX. Project Reactor (используемый в Spring WebFlux) реализует интерфейсы Reactive Streams. Там есть операторы, которые жестко контролируют поток.

Рассмотрим основные инструменты, с которыми вы можете столкнуться:

- RxJava: Старейшая библиотека. Использует тип `Flowable`, который имеет встроенную поддержку обратной связи. Подходит для сложных цепочек трансформации данных, но требует привыкания к функциональному стилю.

- Kotlin Coroutines Flow: Более современный подход. Работает проще для линейного кода. Однако иногда требуется явная буферизация или политика сброса (`onBufferOverflow`), если события наступают быстрее, чем UI их отображает.

- Apache Flink: Для потоковой аналитики данных (Big Data). Коннекторы обязаны честно поддерживать backpressure. Если целевая система (база данных) тупит, вызов записи блокируется, и поток замедляется каскадом вплоть до источника.

- Node.js Streams: Позволяют использовать pipe для передачи данных между процессами. Если sink принимает слишком медленно, source ставится на паузу автоматически.

Распространенные ошибки и способы их исправления

Даже понимая теорию, разработчики часто допускают ошибки, сводящие все усилия на нет. Самая частая проблема - создание «бутылочного горлышка» в середине конвейера обработки. Например, вы читаете быстрый поток, фильтруете его мгновенно, но затем пытаетесь записать каждый результат в базу данных синхронно.

Запись в БД медленная. Поток данных накапливается перед записью, забивая оперативную память. База данных в итоге получает мегатонны запросов и падает, а приложение умирает от нехватки ресурсов.

Чтобы избежать этого, нужно системно смотреть на всю цепочку очередей:

- Очередь задач, ожидающих воркера обработки.

- Очередь событий между воркером и внешним сервисом.

- Буферы внутри самих стриминговых библиотек.

Важно ограничивать глубину всех этих очередей. Также стоит внедрить лимиты (rate-limits) на стороне сервера. Например, разрешать пользователю не более трех параллельных потоковых соединений. Если лимит превышен, отдавайте HTTP статус 429 вместо того, чтобы тратить ресурсы на попытку обслуживания.

Практические рекомендации по настройке

Для успешной реализации асинхронного чтения необходимо придерживаться нескольких правил, проверенных в продакшене.

Начинайте с малого: Устанавливайте небольшие размеры буферов по умолчанию. Лучше чаще запрашивать данные, чем держать огромный буфер, который никогда не опустошится. Если производитель сможет отправить больше, это компенсирует накладные расходы на вызов.

Используйте сигнал завершения: Всегда проверяйте флаг окончания потока (done). Некоторые библиотеки могут продолжать вызывать колбэки даже после того, как источник исчерпан. Обработайте ошибку gracefully, закрывая файл или соединение.

Мониторинг жизненного цикла: Долгоживущие потоки требуют особого внимания. Регулярно измеряйте количество открытых сокетов и занятую память. Инструменты вроде Prometheus или Zipkin помогут увидеть, где возникает перегрузка. Если вы заметили стабильный рост потребления памяти при отсутствии изменений в коде - значит, backpressure где-то сломался.

Как выбрать подходящее решение

Выбор технологии зависит от вашей задачи. Если вы делаете простой frontend-парсер, используйте нативные Web Streams API, они не тянут лишние зависимости. Если вы разрабатываете backend на Java для микросервисов, Project Reactor и Spring WebFlux дадут максимальную интеграцию с экосистемой Spring. Для задач высокопроизводительной аналитики (Real-time analytics) лучше всего подходит Apache Flink, так как он умеет масштабироваться горизонтально и сохранять чекпоинты состояния.

В конечном счете, ключ к успеху - понимание того, что данные никогда не приходят бесплатно. Каждый байт - это нагрузка на сеть и процессор. Механизм обратного давления - это договор между теми, кто дает данные, и теми, кто их потребляет. Соблюдая условия этого договора, вы строите стабильные системы, способные работать годами без перезапусков.

В чем разница между потоком и обычной очередью?

Главное отличие в управлении скоростью. Очередь просто складывает данные, пока место не закончится. Поток с backpressure останавливает отправителя, если приемщик не справляется, предотвращая переполнение.

Почему нельзя просто увеличить размер очереди в базе данных?

Это лишь отсрочит краш. При увеличении очереди вы просто потребляете больше оперативной памяти. Если производительность записи не изменится, система всё равно упадет, но уже позже.

Как backpressure влияет на задержку (latency)?

Он может немного увеличить задержку, так как поток периодически ставится на паузу. Однако это цена за стабильность. Без него задержка станет бесконечной из-за зависания процесса (hang).

Поддерживают ли браузеры потоки файлов из Blob?

Да, современные браузеры поддерживают метод blob.stream(), который возвращает ReadableStream. Это позволяет обрабатывать файлы загруженные через input element по частям.

Что произойдет, если подписчик полностью откажется от получения данных?

Источник должен прекратить генерацию и освободить ресурсы (закрыть соединения, закрыть файлы). Обычно это вызывается методом cancel(), который обязателен для корректной работы любой реактивной системы.